Prepričljivi nesmisli samozavestnega nakladača

Čeprav napredni pogovorni robot ChatGPT za zdaj laže, kot pes teče, nam omogoča, da pokukamo v prihodnost

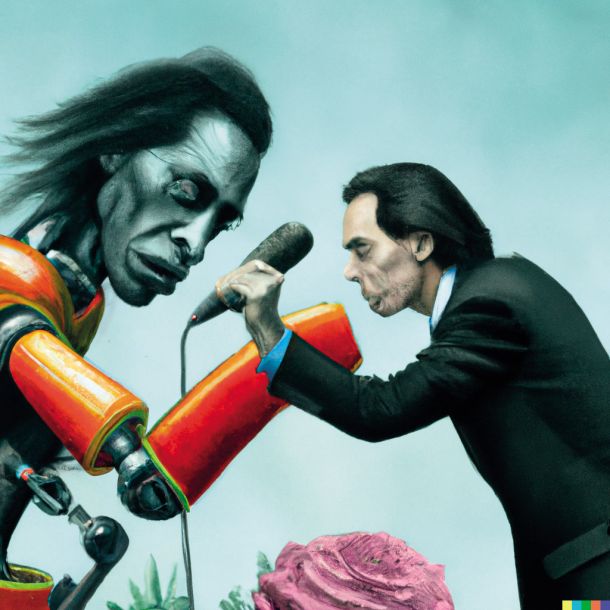

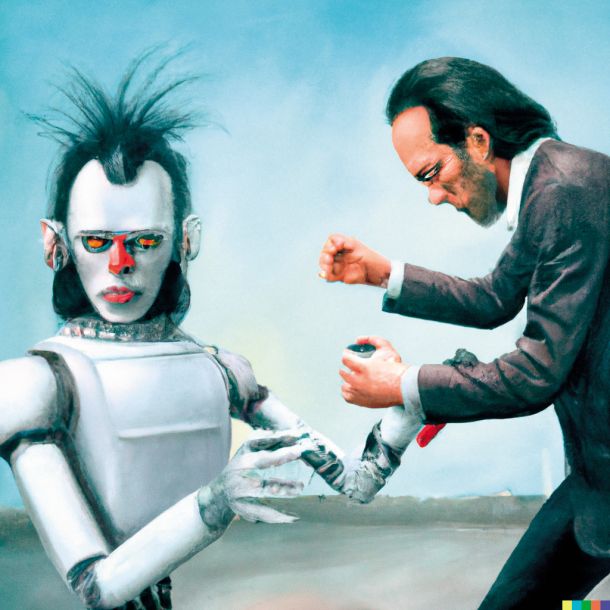

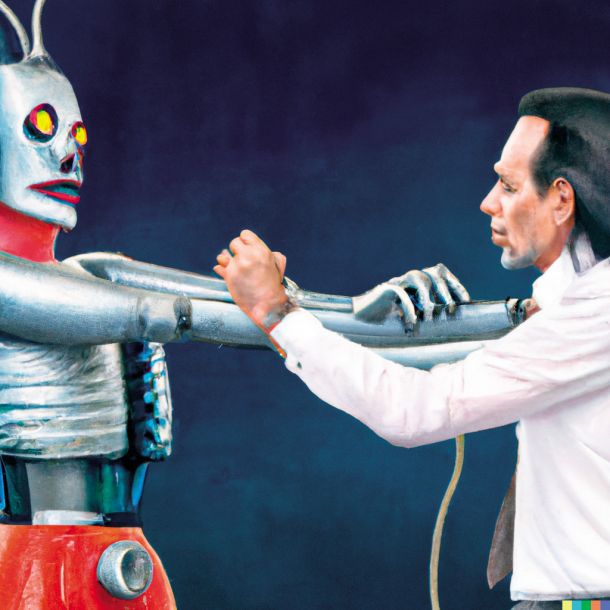

DALL-E, slikarski program, ki besede spreminja v podobe, je za nas ustvaril »hiperrealistične ilustracije boksarskega boja med Nickom Cavom in humanoidnim robotom«, in sicer zato, ker je sloviti glasbenik te dni eden najvidnejših kritikov pesniških podvigov robota ChatGPT.

Lani poleti je programski inženir Blake Lemonie, Googlov ekspert za odgovorno in etično ravnanje z umetno inteligenco, v medijski krajini dvignil ogromno prahu, ko je javno izrazil skrb, da je chatbot (pogovorni robot) LaMDA razvil zavest. Ko je robota vprašal, česa se boji, je ta odvrnil, da je v njem »zelo globok strah, da bi me izključili. Zame bi bilo to natanko tako kot smrt.« Nenavadni pripetljaj je močno spominjal na ikonični prizor iz Kubrickove klasike 2001: Odiseja v vesolju, v katerem se superračunalnik HAL9000 zaradi strahu pred izklopom upre človekovemu ukazu. Lemoniejeva teza je bila zelo hitro ovržena: strokovnjaki za razvoj umetne inteligence se soglasno strinjajo, da je industrija še zelo daleč od tega, da bi se stroji začeli zavedati samih sebe, številni tudi menijo, da je to pravzaprav nemogoče.

Zakup člankov

Celoten članek je na voljo le naročnikom. Če želite zakupiti članek, je cena 4,5 EUR. S tem nakupom si zagotovite tudi enotedenski dostop do vseh ostalih zaklenjenih vsebin. Kako do tedenskega zakupa?

DALL-E, slikarski program, ki besede spreminja v podobe, je za nas ustvaril »hiperrealistične ilustracije boksarskega boja med Nickom Cavom in humanoidnim robotom«, in sicer zato, ker je sloviti glasbenik te dni eden najvidnejših kritikov pesniških podvigov robota ChatGPT.

Lani poleti je programski inženir Blake Lemonie, Googlov ekspert za odgovorno in etično ravnanje z umetno inteligenco, v medijski krajini dvignil ogromno prahu, ko je javno izrazil skrb, da je chatbot (pogovorni robot) LaMDA razvil zavest. Ko je robota vprašal, česa se boji, je ta odvrnil, da je v njem »zelo globok strah, da bi me izključili. Zame bi bilo to natanko tako kot smrt.« Nenavadni pripetljaj je močno spominjal na ikonični prizor iz Kubrickove klasike 2001: Odiseja v vesolju, v katerem se superračunalnik HAL9000 zaradi strahu pred izklopom upre človekovemu ukazu. Lemoniejeva teza je bila zelo hitro ovržena: strokovnjaki za razvoj umetne inteligence se soglasno strinjajo, da je industrija še zelo daleč od tega, da bi se stroji začeli zavedati samih sebe, številni tudi menijo, da je to pravzaprav nemogoče.

Kljub temu pa lahko razumemo, od kod izhaja preganjavica, zaradi katere je Blake Lemonie sprožil medijski cirkus in bil posledično ob službo. Na področju umetne inteligence in strojnega učenja zadnja leta prihaja do tektonskih premikov, chatboti pa so posledično postali izjemno napredna in sofisticirana orodja, ki presenetljivo in osupljivo prepričljivo imitirajo medčloveško sporazumevanje – po novem tudi v slovenščini. To je postalo zelo očitno v zadnjih tednih, ko je OpenAI, vodilno podjetje na področju razvoja umetne inteligence, za javnost odprl dostop do programa ChatGPT. Ta se je po spletu razširil hitreje kot požar in požel hvalo in kritiko, navdušenje in zaskrbljenost.

Okno v prihodnost

ChatGPT je marljivo prebral skorajda ves digitaliziran tekstovni opus celotnega človeštva, od romanov prek člankov do učbenikov in vsega, kar je vmes. V njem je prepoznal jezikovne vzorce, ki jih zdaj poustvarja v interakciji z uporabniki, v kateri se še nadalje uči. Vse, kar ChatGPT potrebuje od uporabnika, je poziv, denimo vprašanje, prošnja ali ukaz, program pa nato ustreže naši želji: lahko nam odgovarja na vprašanja, od trivialnih do velikih, lahko nam razloži določen koncept, interpretira in povzema literaturo, reši matematičen problem, sestavi službeni mejl, napiše dokaj soliden esej ali seminarsko nalogo, ki po kakovosti prekaša podpovprečen izdelek povprečnega študenta. V nekaj sekundah lahko napiše tudi preproste programske kode, pri čemer naj bi bil za zdaj izjemno površen, a ker napreduje izjemno naglo, se vizija prihodnosti, v kateri »roboti ustvarjajo robote«, ne zdi tako za lase privlečena. Napiše pa lahko tudi denimo scenarij, znanstveni članek, recept za slastno večerjo, click-bait novičko, celo kakšno slabo šalo in še slabšo pesem.

ChatGPT je prebral skorajda ves digitaliziran tekstovni opus človeštva. Vse, kar potrebuje od nas, je poziv. Nato napiše skoraj karkoli, tudi denimo scenarij, znanstveni članek, recept za slastno večerjo.

Možnosti je ogromno, a niso neskončne: v nasprotju z uvodoma omenjenim robotkom LaMDA so v ChatGPT vgrajena varovala, ki mu onemogočajo kakršnekoli aluzije na lastno samozavedanje. »Kot računalniški program nimam zavesti ali sposobnosti razmišljanja v tem smislu, kot ga poznamo pri ljudeh,« je ChatGPT pojasnil v ekskluzivnem pogovoru za Mladino. Še več, vanj so vgrajena tudi varovala, ki preprečujejo, da bi program podajal mnenja ali občutke, saj se »zaveda«, da teh ni sposoben imeti. »Delujem na podlagi vnaprej določenih pravil in algoritmov, ki jih je razvilo podjetje OpenAI, in nimam sposobnosti, da bi čutil ali doživljal čustva,« pravi. Prav tako so inženirji podjetja programu OpenAI prepovedali razglabljanje o temah, »o katerih je neprimerno razpravljati«. Inženirji so s tem domiselno preprečili, da bi lahko uporabniki robota »pokvarili«, kot so storili denimo z Microsoftovim chatbotom Tay, s katerim so klepetali na Twitterju in ga v nekaj urah spremenili v fašista, saj se je učil v interakcijah z javnostjo; tako kot se uči tudi ChatGPT.

Kljub tem pretkanim mehanizmom pa ChatGPT za zdaj ne deluje brezhibno, daleč od tega. Omogoča nam, da pokukamo v prihodnost: kot pravi Sam Altman, izvršni direktor podjetja OpenAI, je ChatGPT zgolj »zgodnja demonstracija tega, kaj vse je mogoče«. A že ta »zgodnja demonstracija« nas opozarja, da imajo tovrstna orodja velik potencial, da v svet, ki je že tako preplavljen z dezinformacijami, razširijo še več laži.

Prepričljivi nesmisli

ChatGPT je pri odgovarjanju na vprašanja izredno samozavesten. Pravzaprav njegova samozavest znatno presega njegovo zmogljivost. Posledično laže, kot pes teče. Kot je za časnik The Guardian zgovorno povzel analitik Benedict Evans, je »kot študent, ki samozavestno odgovarja na izpitna vprašanja, čeprav se ni udeležil niti enega predavanja. Očitno lahko samozavesten nakladač napiše zelo prepričljiv nesmisel.« ChatGPT bučke prodaja, kot bi bile absolutna dejstva, a ko ga opomnimo, da se nam je zlagal, se nemudoma opraviči in nam v naslednjem trenutku poskuša dati bolj točen, včasih celo resničen odgovor.

Program presenetljivo smiselno in celovito odgovarja ne le na naša vprašanja, temveč tudi na podvprašanja. Pogovor z njim je vznemirljivo podoben pogovoru s človekom z nadnaravno hitrimi prsti, in ker njegovi odgovori vselej zvenijo dokaj razumno in koherentno, nas lahko hitro prelisiči v legitimnost napisanega, čeprav pogosto blefira. Pri OpenAI pravijo, da je to zanje velik izziv, saj ChatGPT trenutno »nima vira resnice«. Usposobljen je le za predvidevanje, katera beseda sledi prejšnji v dani povedi, kot takšen pa nima sposobnosti preverjanja resničnosti navedenih podatkov, temveč le sposobnost pisanja verodostojno zvenečih trditev – poudarek je na »zvenečih«.

Visokotehnološka oblika plagiatorstva

ChatGPT vsebino ustvarja z imitacijo že obstoječega gradiva, ki ga je ustvaril (in na splet naložil) človek, zato se poraja vprašanje, ali gre pri vsem skupaj pravzaprav le za visokotehnološko obliko plagiatorstva. Ultimativna dilema, povezana z avtorstvom tovrstnih besedil, se vrti okoli vprašanja, kdo je pravzaprav napisal besedilo, ki je ustvarjeno s programom ChatGPT: računalnik ali človek, ki ga upravlja. Se bo ta dilema čez čas uveljavila kot klasična paradoksalna uganka tipa »kaj je bilo prej, kura ali jajce«?

Ekipa raziskovalcev z Univerze Northwestern je nedavno naredila eksperiment, s katerim je dokazala, da lahko besedila, ustvarjena s programom ChatGPT, v svojo legitimnost in pristnost prepričajo tudi akademike, ki v znanstvenih publikacijah delujejo kot recenzenti. Vsak izmed njih je pregledal 25 uvodnih povzetkov znanstvenih člankov na različne teme, polovico teh je napisal ChatGPT, polovico pa dejanski znanstveniki. Recenzenti so bili prepričani, da je kar 32 odstotkov besedil, ki jih je napisal ChatGPT, pravzaprav delo človeške roke.

Študenti in dijaki so v naprednem chatbotu nemudoma prepoznali potencial za lajšanje študijskih tegob in podporo svoji lenobi. Številne šole in univerze so na svojih strežnikih onemogočile dostop do programa, s čimer naj bi študentom preprečile goljufanje. Besedila, ki jih ustvari ChatGPT, namreč zlahka pretentajo ustaljena orodja za prepoznavo plagiatov, kot je denimo Turnitin, ki ga pedagogi (tudi pri nas) pogosto uporabljajo pri preverjanju pristnosti šolskih esejev in seminarskih nalog.

Čeprav so univerzitetniki skorajda takoj po vzponu programa ChatGPT začeli zganjati paniko, da bo napredni chatbot celoten izobraževalni sistem postavil na glavo, jih je te dni pomiril Edward Tian, 22-letni wunderkind z Univerze Princeton. Manj kot dva meseca po zagonu programa ChatGPT je iznašel potencialno rešitev za pojav novodobnega plagiatorstva, ki ga poganja umetna inteligenca: med zimskimi počitnicami je v neki kavarni lastnoročno razvil program, ki naj bi znal z veliko natančnostjo določiti, ali je neko besedilo napisal človek ali robot. Program, imenovan GPTZero, je ustvaril prav z namenom bojevanja proti akademskemu plagiatorstvu, njegov moto pa je: »Ljudje si zaslužijo, da izvejo resnico.« Programerski virtuoz pred vzponom umetne inteligence ne trepeta. Prepričan je, da je umetna inteligenca naša prihodnost, sočasno pa poudarja, da »moramo v prihodnost vstopati odgovorno«. Tian ob računalništvu študira tudi novinarstvo, in kot nekdo, ki so mu besede ravno tako blizu kot programske kode, je prepričan, da je »v človeškem pisanju lepota, ki je računalniki nikoli ne morejo in nikoli ne bi smeli posvojiti«.

Ta pesem je zanič

O ustvarjalnem potencialu generativne umetne inteligence je svet lani na dolgo in široko razglabljal ob vzponu orodij, kot sta Midjourney in DALL-E, »slikarskih« programov, ki besede spreminjajo v slike. Uporabnik z besednimi ukazi ne dirigira zgolj vsebine računalniško generiranih podob, temveč tudi njihov estetski slog. S tovrstnimi programi lahko z minimalnim trudom v nekaj sekundah ustvarimo podobe, ki so videti kot plod dolgega in napornega dela, podkrepljenega z resnimi risarskimi veščinami. Ob tem se skeptiki sprašujejo, ali lahko umetnine, ki jih ustvari umetna inteligenca, sploh obravnavamo kot »pravo umetnost«?

Program ChatGPT smo prosili, naj napiše kratek članek v slogu tednika Mladina.

Žgoča debata o umetniški vrednosti stvaritev umetne inteligence se nadaljuje z nenadnim vzponom programa ChatGPT, ki zna med drugim pisati tudi poezijo. Podobno kot pri generatorjih podob lahko tudi pesniškega robota usmerjamo z vsebinskimi in estetskimi smernicami, na primer: »Napiši sonet o ljubezni v slogu Franceta Prešerna.« V nekaj sekundah napiše generično pesem osnovnošolske narave, ki se ponaša z verzi tipa »ljubezen je kot sonce, ki vedno sije, v srcu svoje lepote nas navdihuje«. Program nam v istem dihu samoiniciativno napiše tudi izgovor za amatersko naravo svojih pesniških veščin: »Upoštevajte, da Prešeren velja za enega največjih slovenskih pesnikov, njegov slog pa je precej kompleksen in težko posnemljiv. To je moj poskus, da bi napisal pesem v njegovem slogu, vendar ni natančna replika njegovega dela.«

Ko je glasbenik Nick Cave preučil eno od pesmi, ki jih je ChatGPT napisal z oponašanjem njegovega pesniškega sloga, je ugotovil: »Ta pesem je bulšit, groteskno norčevanje iz tega, kaj pomeni biti človek.«

Te dni se je oglasil Nick Cave, sloviti avstralski pesnik in glasbenik, ki na svoji spletni strani Red Hand Files redno, predano in poglobljeno odgovarja na pisma poslušalcev. Odgovoril je tudi na eno izmed ducata prošenj za komentar na pesniški potencial programa ChatGPT, saj naj bi ta znal pisati tudi poezijo v slogu Nicka Cava. A ker je program Cava zgolj imitiral, denimo tako, da je v pesmi vključil biblične reference in temačne eksistencialne misli, njegove stvaritve niso pretirano prepričljive, saj delujejo kot karikatura Cavove poezije, nikakor pa ne kot njegova dejanska stvaritev.

Cave že uvodoma pove, da nad to tehnologijo ne čuti navdušenja, ki sicer preveva splošno javnost. Ko je preučil eno od pesmi, ki jih je ChatGPT napisal z oponašanjem njegovega pesniškega sloga, je ugotovil: »Ta pesem je bulšit, groteskno norčevanje iz tega, kaj pomeni biti človek.« Glasbenik poudarja, da ključ do pisanja dobre pesmi »ni mimikrija, poustvarjanje ali imitacija, temveč nasprotno«. Prepričan je, da »pisanje pesmi zahteva človečnost«. Kaj na to pravi ChatGPT? »Znano je, da se Nick Cave zavzema za avtentičnost in iskrenost v ustvarjanju umetnin in da meni, da je ključ do dobre pesmi prisotnost avtorjevega osebnega dojemanja in izkušenj,« zapiše. In nadaljuje: »Moja ustvarjalnost temelji na matematičnih algoritmih in ne na človeškem procesu ustvarjanja.«

Najpogostejše pojasnilo oziroma izgovor, s katerim zagovorniki umetne inteligence branijo spodrsljaje programa ChatGPT, je navedba dejstva, da je ta tehnologija še v povojih, v testni fazi, katere cilj je nadaljnje učenje. Nick Cave to razume, a ravno v tem prepoznava grožnjo: »Groza umetne inteligence je morda to, da bo za vselej ostala v povojih, saj bo morala iti dlje in dlje, vedno naprej, čedalje hitreje.« Dodaja, da »nas premika proti utopični prihodnosti ali proti popolnemu uničenju«, in se vpraša, »kdo bi vedel, v katero smer bo zavila? Sodeč po tej pesmi situacija ni videti dobro. Apokalipsa se bliža. Ta pesem je zanič.«

Pisma bralcev pošljite na naslov pisma@mladina.si. Minimalni pogoj za objavo je podpis z imenom in priimkom ter naslov. Slednji ne bo javno objavljen.