Poplava opolzkih ponaredkov

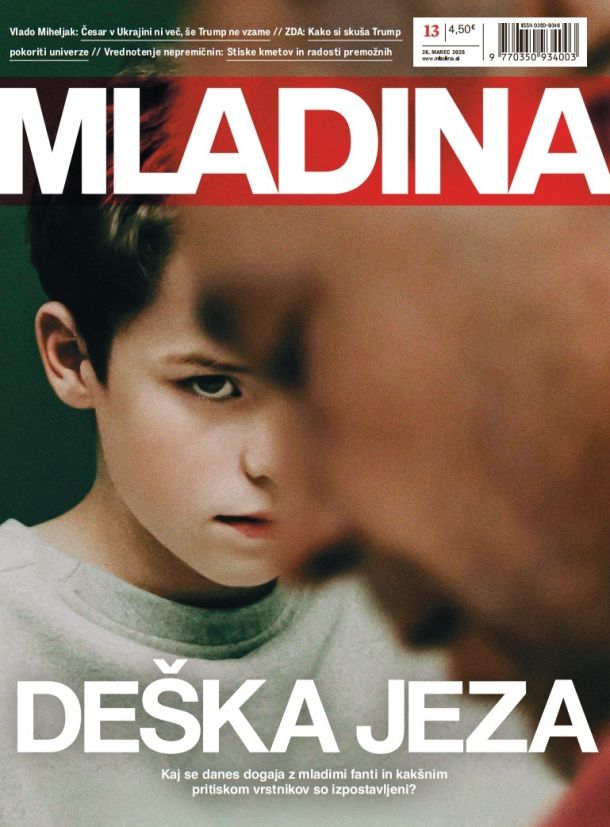

Spletni troli so med organizirano akcijo po omrežju X razširili lažne gole podobe pevke Taylor Swift

Taylor Swift ni prva niti edina javna osebnost, ki je bila žrtev lažnih golih podob, a te naj bi zdaj generirala kar umetna inteligenca

© Profimedia

Ob vzponu sistemov generativne umetne inteligence je marsikdo opozarjal, da bodo ti sistemi zabrisali meje med resničnostjo in domišljijo, širili dezinformacije, nas popeljali v novo obdobje lažnih novic in sčasoma zrušili temelje demokracije. Podobno je bilo tudi pred dobrimi petimi leti, ko so se prvič pojavili tako imenovani posnetki »deepfake«, hiperrealistični videoponaredki, s katerimi lahko kogarkoli pripravimo do tega, da reče ali stori karkoli. A tudi zdaj, ko ponaredke »deepfake« poganja generativna umetna inteligenca in jih lahko tako rekoč kdorkoli ustvarja kot po tekočem traku, se zdi, da nas nove ustvarjalne tehnologije še ne bodo pahnile v pogubo. Namesto tega se bomo očitno znašli v poplavi lažne, nekonsenzualne pornografije, kakršna se je te dni kot požar razširila po družbenem omrežju X (nekdanjem Twitterju).

Zakup člankov

Celoten članek je na voljo le naročnikom. Če želite zakupiti članek, je cena 4,5 EUR. S tem nakupom si zagotovite tudi enotedenski dostop do vseh ostalih zaklenjenih vsebin. Kako do tedenskega zakupa?

Taylor Swift ni prva niti edina javna osebnost, ki je bila žrtev lažnih golih podob, a te naj bi zdaj generirala kar umetna inteligenca

© Profimedia

Ob vzponu sistemov generativne umetne inteligence je marsikdo opozarjal, da bodo ti sistemi zabrisali meje med resničnostjo in domišljijo, širili dezinformacije, nas popeljali v novo obdobje lažnih novic in sčasoma zrušili temelje demokracije. Podobno je bilo tudi pred dobrimi petimi leti, ko so se prvič pojavili tako imenovani posnetki »deepfake«, hiperrealistični videoponaredki, s katerimi lahko kogarkoli pripravimo do tega, da reče ali stori karkoli. A tudi zdaj, ko ponaredke »deepfake« poganja generativna umetna inteligenca in jih lahko tako rekoč kdorkoli ustvarja kot po tekočem traku, se zdi, da nas nove ustvarjalne tehnologije še ne bodo pahnile v pogubo. Namesto tega se bomo očitno znašli v poplavi lažne, nekonsenzualne pornografije, kakršna se je te dni kot požar razširila po družbenem omrežju X (nekdanjem Twitterju).

Tarča množične produkcije opolzkih ponaredkov je bila pop velikanka Taylor Swift. Nekatere podobe so na omrežju X imele tudi po več deset milijonov ogledov in več sto tisoč všečkov, preden jih je omrežje odstranilo, saj so kršile pravila uporabe. »Objavljanje podob, ki vključujejo nekonsenzualno goloto, je na omrežju X strogo prepovedno in imamo politiko ničelne tolerance do tovrstnih vsebin,« so zapisali na oddelku za kibernetsko varnost omrežja X.

Horde zvestih fenov ameriške pevke so hitro priskočile na pomoč in pod geslom »zaščitimo Taylor Swift« začele množično objavljati prave posnetke aktualne kraljice popa. Tako so ravnale v upanju, da bodo te objave zasenčile poplavo spornih fotoponaredkov, a reševalna akcija ni bila uspešna. Ker je nenavadni trend objavljanja sintetičnih podob gole pevke hitro ušel izpod nadzora, je X v iskalniku začasno blokiral geslo »Taylor Swift«, dogajanje pa so komentirali celo iz Bele hiše: tiskovna predstavnica Karine Jean-Pierre je zadevo označila za »alarmantno« in opozorila na potrebo po zakonodaji, s katero bo mogoče ljudi zavarovati pred lažno pornografijo, ustvarjeno z umetno inteligenco oziroma slikarskimi roboti, ki besedne ukaze pretvarjajo v čedalje bolj realistične podobe.

Raziskava spletne revije 404 Media je ugotovila, da je bila za poplavo spornih podob pravzaprav kriva organizirana akcija spletnih trolov, ki so požar zanetili v zaprti skupini na omrežju Telegram, kjer si uporabniki izmenjujejo opolzke podobe, pogosto ustvarjene s programom Microsoft Designer.

Na poročilo se je naglo odzval Microsoft in program posodobil tako, da je v njem zdaj ustvarjanje nekonsenzualne pornografije onemogočeno. »Okrepili smo varnostne sisteme, da bomo lahko še naprej preprečevali zlorabo svojih storitev,« je povedala Sarah Bird, vodja Microsoftovega oddelka za inženirstvo umetne inteligence.

Pisma bralcev pošljite na naslov pisma@mladina.si. Minimalni pogoj za objavo je podpis z imenom in priimkom ter naslov. Slednji ne bo javno objavljen.